Close

- کشاورزی، فناوری زیستی و صنایع غذایی

- دارو و فرآوردهها

- ماشینآلات و تجهیزات پیشرفته

- وسایل، ملزومات و تجهیزات پزشکی

- سختافزار برق، الکترونیک، لیزر، فوتونیک

- ICT و نرمافزارهای رایانه ای و همراه

- خدمات تجاریسازی

- صنایع فرهنگی، خلاق، علوم انسانی و اجتماعی

- همه دسته بندی ها

- Back

- محصولات استراتژیک

- صنایع فرهنگی، خلاق، علوم انسانی و اجتماعی

- دارو و فرآوردهها

- مواد و محصولات فناوریهای شیمیایی

- Back

- محصولات مبتنی بر فناوریهای شیمیایی

- Back

- پوشرنگ های پیشرفته

- جوهرهای چاپ

- سنتز رزینها و افزودنی های پلیمری

- نرمافزارهای پیش بینی رنگ و رنگهمانندی

- چسب های پیشرفته پلیمری

- محصولات آرایشی و بهداشتی و ضدعفونی کننده

- روغن ها و گریس های صنعتی

- مواد شیمیایی پیشرفته برای کاربردهای خاص

- Back

- افزودنی های پیشرفته صنایع نفت، گاز و پتروشیمی و معدن

- سیالات پیشرفته حفاری نفت و گاز

- اسیدهای پیشرفته در مقیاس صنعتی

- ترکیبات معدنی پیشرفته با کاربرد دارو

- بازهای پیشرفته در مقیاس صنعتی با کاربرد غذا و دارو

- فرآوری و استحصال ترکیبات معدنی پیشرفته برپایه فلزات گران بها

- حلال های پیشرفته در مقیاس صنعتی

- سنتز و فرمولاسیون افزودنی های سنتزی

- پیل سوختی و هیدروژن

- باتری ها

- کاتالیست ها و جاذب های پیشرفته

- کاتالیست های با پایه مونولیتی

- نمایش همه

- مواد پیشرفته (پلیمرها و کامپوزیتها)

- لایسنس واحدهای پالایشی و پتروشیمی

- Back

- لایسنس واحدهای پالایشی

- Back

- لایسنس واحدهای افزایش کیفیت فرآورده های هیدروکربنی (بنزین، دیزل، نفت سفید و نفت کوره)

- لایسنس واحدهای تبدیلی و سبک سازی

- لایسنس سیستمهای پیشرفته بهینهسازی فرآیندهای پالایشی

- لایسنس سیستمهای پیشرفته مورد استفاده در بازیابی گازهای ارسالی به فلر

- لایسنس سیستم نمک زدائی از نفت خام

- لایسنس تولید مواد با طراحی فرایند پیشرفته جهت انتقال گاز، نفت و فراوردهها

- لایسنس فرآیند تولید روغن های پایه گروه 2 و 3

- لایسنس واحدهای پتروشیمیایی

- نرم افزارهای پیشرفته شبیه سازی و مدل سازی پایین دستی نفت و صنایع شیمیایی

- فناوری نانو

- مواد پیشرفته (سرامیکها و فلزات)

- وسایل، ملزومات و تجهیزات پزشکی

- ماشینآلات و تجهیزات پیشرفته

- Back

- تجهیزات پیشرفته صنعت نفت و گاز

- Back

- تجهیزات پیشرفته اکتشاف نفت

- تجهیزات حفاری نفت

- نرمافزارهای نفت و گاز

- تجهیزات و ابزارهای بهرهبرداری نفت

- تجهیزات میاندستی و پاییندستی نفت

- Back

- مخازن، تاورها و راکتورهای پیشرفته

- مشعلهای پیشرفته

- بویلرهای نیروگاهی و صنعتی

- مبدل های حرارتی و برودتی

- شیرهای صنعتی پیشرفته

- تجهیزات و فناوری های خطوط لوله

- تجهیزات پیگ رانی

- تجهیزات احداث،تعمیر یا پایش خوردگی خطوط

- طراحی پایه، تفصیلی و نصب خطوط دریایی

- تعمیر و نگهداری خطوط دریایی

- آنالایزر فرایندی و میترینگ پتروپالایشی

- پایش و حفاظت صنعتی پتروپالایشی

- تجهیزات قطعات فلزی،سرامیکی و...

- Back

- تجهیزات تولید مواد اولیه فلزی، سرامیکی و پلیمری

- تجهیزات پیشرفته شکلدهی فلزات

- تجهیزات شکلدهی سرامیکها و متالوژی پودر

- تجهیزات پیشرفته ریختهگری فلزات

- تجهیزات جوشکاری و اتصال دهی

- تجهیزات پیشرفته ماشینکاری

- انواع کوره های پیشرفته

- تجهیزات،سامانهها و قطعات فناوری خلأ

- تجهیزات پوشش دهی و مهندسی سطح

- دستگاههای شکلدهی پلیمرها و کامپوزیتهای پلیمری

- راکتورهای شیمیایی پیشرفته

- تجهیزات اختصاصی تولید نانومواد

- ماشینهای دوار و تجهیزات وابسته

- تجهیزات حوزه انرژی های تجدیدپذیر

- تجهیزات پیشرفته هستهای

- هواگردها، تجهیزات و سازههای هوافضا

- سامانهها و تجهیزات هیدرولیکی و پنوماتیکی

- شبیهسازهای پیشرفته

- تجهیزات پیشرفته سایر حوزهها

- خدمات آزمایشگاهی و طراحی مهندسی

- تجهیزات آزمایشگاهی و کنترل کیفی

- Back

- تجهیزات بررسی خواص مکانیکی و توپوگرافی مواد

- تجهیزات بررسی خواص مواد

- تجهیزات آمادهسازی مواد

- تجهیزات بررسی میکروسکوپی و ریزساختاری مواد

- تجهیزات آزمایشگاهی پوششدهی

- تجهیزات حوزه میکرو و نانوالکترونیک

- تجهیزات آزمایشگاهی مکانیک

- تجهیزات مجموعه مهندسی نفت

- تجهیزات حوزه تست و آزمون و کنترل کیفی

- تجهیزات عمومی آزمایشگاهی

- تجهیزات زیستفناوری و پزشکی (غیر از تشخیص و درمان)

- سختافزار برق، الکترونیک، لیزر، فوتونیک

- Back

- سختافزارهای الکترونیکی و رایانهای

- Back

- طراحی و ساخت بردهای پردازش و کنترل

- ابزارهای ذخیرهسازی

- ادوات ورودی و خروجی

- طراحی و ساخت رایانههای قابلحمل

- ادوات قابلحمل هوشمند

- تجهیزات سختافزاری شبکه

- سامانههای پردازشی متمرکز و توزیعشده

- شبکه حسگر بیسیم

- سامانه های خاص منظوره هوشمند

- طراحی و ساخت سامانههای کنترل هوشمند

- طراحی و پیادهسازی سیستمهای هوشمند اتوماسیون

- سامانههای مرتبط با اینترنت اشیاء

- نمایش همه

- میکروالکترونیک

- مدارهای الکترونیکی

- تولید

- انتقال

- توزیع

- ماشینهای الکتریکی

- الکترونیک قدرت

- اندازهگیری و ابزار دقیق

- سامانههای کنترل و اتوماسیون صنعتی

- تجهیزات ارتباطی، مخابراتی، اویونیک و هوافضا

- لیزر و فوتونیک

- ICT و نرمافزارهای رایانه ای و همراه

- خدمات تجاریسازی

- کشاورزی، فناوری زیستی و صنایع غذایی

Menu

- کشاورزی، فناوری زیستی و صنایع غذایی

- دارو و فرآوردهها

- ماشینآلات و تجهیزات پیشرفته

- Back

- تجهیزات پیشرفته صنعت نفت و گاز

- تجهیزات قطعات فلزی،سرامیکی و...

- تجهیزات اختصاصی تولید نانومواد

- ماشینهای دوار و تجهیزات وابسته

- تجهیزات حوزه انرژی های تجدیدپذیر

- تجهیزات پیشرفته هستهای

- هواگردها، تجهیزات و سازههای هوافضا

- سامانهها و تجهیزات هیدرولیکی و پنوماتیکی

- شبیهسازهای پیشرفته

- تجهیزات پیشرفته سایر حوزهها

- خدمات آزمایشگاهی و طراحی مهندسی

- تجهیزات آزمایشگاهی و کنترل کیفی

- وسایل، ملزومات و تجهیزات پزشکی

- سختافزار برق، الکترونیک، لیزر، فوتونیک

- ICT و نرمافزارهای رایانه ای و همراه

- خدمات تجاریسازی

- صنایع فرهنگی، خلاق، علوم انسانی و اجتماعی

- همه دسته بندی ها

- Back

- محصولات استراتژیک

- صنایع فرهنگی، خلاق، علوم انسانی و اجتماعی

- دارو و فرآوردهها

- مواد و محصولات فناوریهای شیمیایی

- Back

- محصولات مبتنی بر فناوریهای شیمیایی

- Back

- پوشرنگ های پیشرفته

- جوهرهای چاپ

- سنتز رزینها و افزودنی های پلیمری

- نرمافزارهای پیش بینی رنگ و رنگهمانندی

- چسب های پیشرفته پلیمری

- محصولات آرایشی و بهداشتی و ضدعفونی کننده

- روغن ها و گریس های صنعتی

- مواد شیمیایی پیشرفته برای کاربردهای خاص

- Back

- افزودنی های پیشرفته صنایع نفت، گاز و پتروشیمی و معدن

- سیالات پیشرفته حفاری نفت و گاز

- اسیدهای پیشرفته در مقیاس صنعتی

- ترکیبات معدنی پیشرفته با کاربرد دارو

- بازهای پیشرفته در مقیاس صنعتی با کاربرد غذا و دارو

- فرآوری و استحصال ترکیبات معدنی پیشرفته برپایه فلزات گران بها

- حلال های پیشرفته در مقیاس صنعتی

- سنتز و فرمولاسیون افزودنی های سنتزی

- پیل سوختی و هیدروژن

- باتری ها

- کاتالیست ها و جاذب های پیشرفته

- کاتالیست های با پایه مونولیتی

- نمایش همه

- مواد پیشرفته (پلیمرها و کامپوزیتها)

- لایسنس واحدهای پالایشی و پتروشیمی

- Back

- لایسنس واحدهای پالایشی

- Back

- لایسنس واحدهای افزایش کیفیت فرآورده های هیدروکربنی (بنزین، دیزل، نفت سفید و نفت کوره)

- لایسنس واحدهای تبدیلی و سبک سازی

- لایسنس سیستمهای پیشرفته بهینهسازی فرآیندهای پالایشی

- لایسنس سیستمهای پیشرفته مورد استفاده در بازیابی گازهای ارسالی به فلر

- لایسنس سیستم نمک زدائی از نفت خام

- لایسنس تولید مواد با طراحی فرایند پیشرفته جهت انتقال گاز، نفت و فراوردهها

- لایسنس فرآیند تولید روغن های پایه گروه 2 و 3

- لایسنس واحدهای پتروشیمیایی

- نرم افزارهای پیشرفته شبیه سازی و مدل سازی پایین دستی نفت و صنایع شیمیایی

- فناوری نانو

- مواد پیشرفته (سرامیکها و فلزات)

- وسایل، ملزومات و تجهیزات پزشکی

- ماشینآلات و تجهیزات پیشرفته

- Back

- تجهیزات پیشرفته صنعت نفت و گاز

- Back

- تجهیزات پیشرفته اکتشاف نفت

- تجهیزات حفاری نفت

- نرمافزارهای نفت و گاز

- تجهیزات و ابزارهای بهرهبرداری نفت

- تجهیزات میاندستی و پاییندستی نفت

- Back

- مخازن، تاورها و راکتورهای پیشرفته

- مشعلهای پیشرفته

- بویلرهای نیروگاهی و صنعتی

- مبدل های حرارتی و برودتی

- شیرهای صنعتی پیشرفته

- تجهیزات و فناوری های خطوط لوله

- تجهیزات پیگ رانی

- تجهیزات احداث،تعمیر یا پایش خوردگی خطوط

- طراحی پایه، تفصیلی و نصب خطوط دریایی

- تعمیر و نگهداری خطوط دریایی

- آنالایزر فرایندی و میترینگ پتروپالایشی

- پایش و حفاظت صنعتی پتروپالایشی

- تجهیزات قطعات فلزی،سرامیکی و...

- Back

- تجهیزات تولید مواد اولیه فلزی، سرامیکی و پلیمری

- تجهیزات پیشرفته شکلدهی فلزات

- تجهیزات شکلدهی سرامیکها و متالوژی پودر

- تجهیزات پیشرفته ریختهگری فلزات

- تجهیزات جوشکاری و اتصال دهی

- تجهیزات پیشرفته ماشینکاری

- انواع کوره های پیشرفته

- تجهیزات،سامانهها و قطعات فناوری خلأ

- تجهیزات پوشش دهی و مهندسی سطح

- دستگاههای شکلدهی پلیمرها و کامپوزیتهای پلیمری

- راکتورهای شیمیایی پیشرفته

- تجهیزات اختصاصی تولید نانومواد

- ماشینهای دوار و تجهیزات وابسته

- تجهیزات حوزه انرژی های تجدیدپذیر

- تجهیزات پیشرفته هستهای

- هواگردها، تجهیزات و سازههای هوافضا

- سامانهها و تجهیزات هیدرولیکی و پنوماتیکی

- شبیهسازهای پیشرفته

- تجهیزات پیشرفته سایر حوزهها

- خدمات آزمایشگاهی و طراحی مهندسی

- تجهیزات آزمایشگاهی و کنترل کیفی

- Back

- تجهیزات بررسی خواص مکانیکی و توپوگرافی مواد

- تجهیزات بررسی خواص مواد

- تجهیزات آمادهسازی مواد

- تجهیزات بررسی میکروسکوپی و ریزساختاری مواد

- تجهیزات آزمایشگاهی پوششدهی

- تجهیزات حوزه میکرو و نانوالکترونیک

- تجهیزات آزمایشگاهی مکانیک

- تجهیزات مجموعه مهندسی نفت

- تجهیزات حوزه تست و آزمون و کنترل کیفی

- تجهیزات عمومی آزمایشگاهی

- تجهیزات زیستفناوری و پزشکی (غیر از تشخیص و درمان)

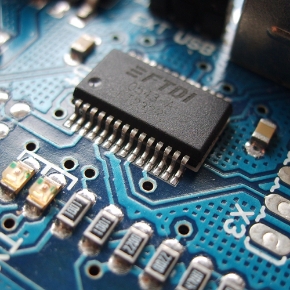

- سختافزار برق، الکترونیک، لیزر، فوتونیک

- Back

- سختافزارهای الکترونیکی و رایانهای

- Back

- طراحی و ساخت بردهای پردازش و کنترل

- ابزارهای ذخیرهسازی

- ادوات ورودی و خروجی

- طراحی و ساخت رایانههای قابلحمل

- ادوات قابلحمل هوشمند

- تجهیزات سختافزاری شبکه

- سامانههای پردازشی متمرکز و توزیعشده

- شبکه حسگر بیسیم

- سامانه های خاص منظوره هوشمند

- طراحی و ساخت سامانههای کنترل هوشمند

- طراحی و پیادهسازی سیستمهای هوشمند اتوماسیون

- سامانههای مرتبط با اینترنت اشیاء

- نمایش همه

- میکروالکترونیک

- مدارهای الکترونیکی

- تولید

- انتقال

- توزیع

- ماشینهای الکتریکی

- الکترونیک قدرت

- اندازهگیری و ابزار دقیق

- سامانههای کنترل و اتوماسیون صنعتی

- تجهیزات ارتباطی، مخابراتی، اویونیک و هوافضا

- لیزر و فوتونیک

- ICT و نرمافزارهای رایانه ای و همراه

- خدمات تجاریسازی

- کشاورزی، فناوری زیستی و صنایع غذایی

تعداد (0)

شما هیچ موردی در سبد خرید خود ندارید

همه دسته بندی ها

Menu

سبد خرید

Filters

Personal menu

امکانات

جستجو

- خانه /

- آموزش شبکه عصبی مصنوعی -- از صفر به زبان ساده

خدمات مشتریان

حساب کاربری من

کلیه حقوق این سایت متعلق به معاونت فناوری وزارت علوم ، تحقیقات و فناوری و پردیس هاب بین المللی فناوری و نواوری ایران است.